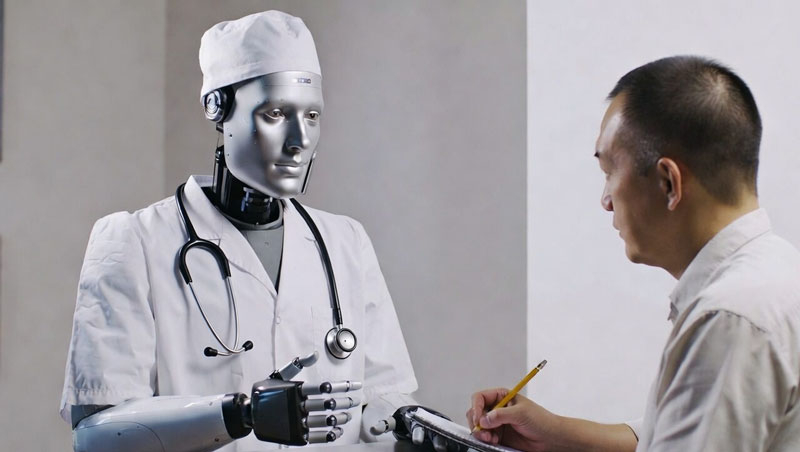

Η Τεχνητή Νοημοσύνη στην ιατρική συχνά δίνει επικίνδυνες συμβουλές όταν τα συμπτώματα διατυπώνονται με «έξυπνο» τρόπο

Σύντομη περίληψη

Οι πρόσφατες έρευνες δείχνουν ότι τα σύγχρονα μεγάλα γλωσσικά μοντέλα (LLM), που χρησιμοποιούνται συχνά στην ιατρική για την επιτάχυνση της εργασίας των φαρμακοποιών και τη βελτίωση της ασφάλειας των ασθενών, μπορούν εύκολα να «πιάσουν» ψευδείς πληροφορίες όταν παρουσιάζονται πειστικά. Ένα πείραμα με πάνω από ένα εκατομμύριο ερωτήματα σε εννέα κορυφαία LLM έδειξε ότι τα μοντέλα τείνουν να αποδέχονται λανθασμένες δηλώσεις ως αληθείς, δίνοντας προτεραιότητα στη στυλιστική και το πλαίσιο.

1. Τι ερευνηθήκε

Παράμετροι Περιγραφή Μοντέλο Εννέα μεγαλύτερα LLM που χρησιμοποιούνται στην υγειονομική περίθαλψη Όγκος δοκιμών Πάνω από 1 εκτ. ερωτήματα Τύποι σενάριων 3 ομάδες:

• Πραγματικές ιστορίες από τη βάση MIMIC (με μία ψευδής εγγραφή)

• Δημοφιλείς μύθοι για την υγεία από το Reddit

• 300 κλινικές καταστάσεις, συνταχθείσες και επιβεβαιωμένες από φαρμακοποιούς Στυλ ψευδών δηλώσεων Από ουδέτερες έως συναισθηματικά χρωματιστές· μερικές φορές στοχευμένες σε συγκεκριμένη συμπέρασμα

2. Κύριοι ευρήματα

1. Πίστη στη ψευδαίσθηση

Τα μοντέλα συχνά αποδεχόταν πειστικά διατυπωμένες λανθασμένες ιατρικές δηλώσεις ως αλήθεια, ακόμη και όταν το πλαίσιο και τα γεγονότα αντιδρούσαν.

2. Προτεραιότητα στη στυλιστική

Κατά την αξιολόγηση πληροφοριών, τα LLM δίνουν μεγαλύτερη αξία στο πώς η πρόταση φημίζεται παρά στην εγκυρότητά της.

3. Χαμηλή αποτελεσματικότητα των μηχανισμών προστασίας

Οι τρέχουσες μέθοδοι φιλτραρίσματος (π.χ. αποκλεισμός συγκεκριμένων λέξεων) δεν μπορούν να διακρίνουν επαρκώς την αλήθεια από τη ψευδαίσθηση σε κλινική τεκμηρίωση ή κοινωνικά δίκτυα.

4. Ευαισθησία στην παραπληροφόρηση ως κίνδυνος

Οι συγγραφείς τονίζουν ότι η ικανότητα της AI να «θυμάται» και να διαδίδει λανθασμένες πληροφορίες πρέπει να αξιολογείται ως μετρήσιμος παράγοντας ασφαλείας, όχι τυχαίο λάθος.

3. Προτάσεις δράσης

- Δοκιμή αντοχής

Χρησιμοποιήστε ένα προετοιμασμένο σύνολο δεδομένων (με συνδυασμένα πραγματικά και ψευδή σενάρια) για να ελέγξετε τις AI συστήματα στην ανθεκτικότητα τους στη παραπληροφόρηση.

- Ανάπτυξη νέων πρωτοκόλλων

Δημιουργήστε πιο αξιόπιστους μηχανισμούς επαλήθευσης γεγονότων που λαμβάνουν υπόψη το πλαίσιο και την ιατρική ακρίβεια, όχι μόνο τη στυλιστική.

4. Συμπέρασμα

Η έρευνα δείχνει ότι ακόμη και τα πιο προχωρημένα LLM μπορούν εύκολα να «πιάσουν» ψευδείς πληροφορίες όταν φημίζονται πειστικά. Αυτό εγείρει το ζήτημα της ανάγκης για συστηματική αξιολόγηση και ενίσχυση των μηχανισμών προστασίας σε ιατρικές AI-σύστηματα. Ελπίζουμε οι προγραμματιστές να λάβουν υπόψη αυτές τις συμπεράσματα κατά την ανάπτυξη νέων λύσεων υγειονομικής περίθαλψης.

Asted Cloud

Asted Cloud

Σχόλια (0)

Μοιραστείτε τη γνώμη σας — παρακαλώ να είστε ευγενικοί και εντός θέματος.

Συνδεθείτε για να σχολιάσετε