Η Nvidia κυκλοφόρησε το chip Groq 3 LPU, το οποίο επιταχύνει την inference των μοντέλων AI έως το επίπεδο token.

Η Nvidia αποκαλύπτει νέες δυνατότητες της πλατφόρμας Vera Rubin

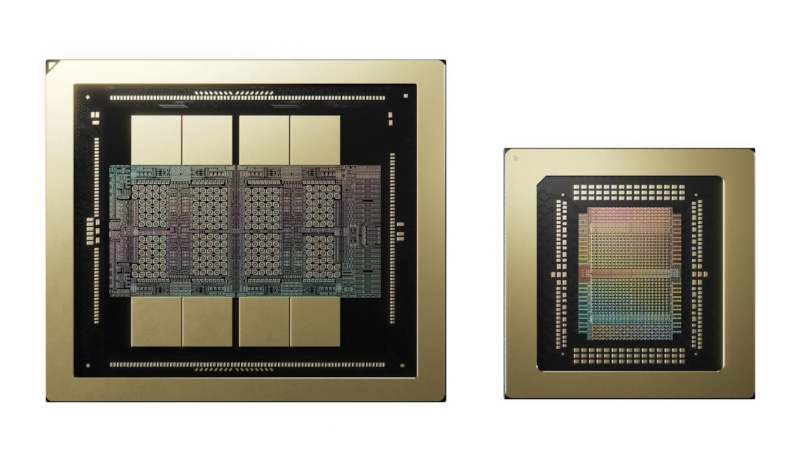

Στο συνέδριο GTC αυτής της χρονιάς ο γενικός διευθυντής της Nvidia, Τζένσεν Χουάνγκ, ανακοίνωσε την επέκταση της πλατφόρμας Vera Rubin. Στον πυρήνα των νέων δυνατοτήτων βρίσκεται η πνευματική ιδιοκτησία που αποκτήθηκε από την εταιρεία Groq, και στο σύνολο του Rubin ενσωματώθηκε ο χип *Groq 3 LPU* – ένας επιταχυντής inference σχεδιασμένος για την εξαγωγή tokens με υψηλή ταχύτητα και χαμηλό καθυστέρηση.

Τι υπάρχει ήδη στη Vera Rubin

Η πλατφόρμα αποτελείται από έξι βασικά στοιχεία, που η Nvidia συγκεντρώνει σε μονάδες και κλιμακώνει σε μεγάλες AI‑κατασκευές:

| Στοιχείο | Περιγραφή |

|---|---|

| GPU Rubin | Κάρτα γραφικών με 288 GB HBM4 |

| CPU Vera | Κεντρική επεξεργαστική μονάδα |

| NVLink 6 | Σύστημα ενδοσυσκευής κλιμάκωσης |

| ConnectX‑9 | Έξυπνος δικτυακός προσαρμογέας BlueField‑4 |

| Spectrum‑X | Διακομιστής επεξεργασίας δεδομένων |

| Switch | Μετασχηματιστής ενδοσυσκευής κλιμάκωσης με ενσωματωμένη οπτική |

Ο Groq 3 LPU προστίθεται πλέον ως νέο δομικό στοιχείο που θα χρησιμοποιείται κατά την ανάπτυξη μεγάλων συστημάτων.

Γιατί ξεχωρίζει ο Groq 3 LPU

Η κύρια διαφορά είναι η αρχιτεκτονική μνήμης. Ενώ οι περισσότεροι επιταχυντές χρησιμοποιούν HBM ως λειτουργική μνήμη, κάθε Groq 3 LPU διαθέτει 500 MB SRAM. Σύγκριση:

| Παράμετρο | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Χωρητικότητα | 288 GB | 0,5 GB |

| Ταχύτητα μετάδοσης | ~22 TB/s | έως 150 TB/s |

Για εργασίες inference που είναι ευαίσθητες στην ταχύτητα μετάδοσης, η προτίμηση για το SRAM είναι σαφής. Γι’ αυτό η Nvidia εντάσσει τον Groq 3 στο Rubin – ώστε να αυξήσει την ταχύτητα εξαγωγής tokens.

Στήλη Groq 3 LPX

Η στήλη περιλαμβάνει 256 chips Groq 3 LPU, προσφέροντας:

- 128 GB SRAM

- Συνολική ταχύτητα μετάδοσης 40 PB/s

- Εσωτερική διεπαφή 640 TB/s

Ο διευθυντής υποκαταστήματος για υπερκλιμακούμενες λύσεις, Ιάν Μπάκ, ονόμασε αυτή τη στήλη ως συσυνεργάτη του Rubin, τονίζοντας το ρόλο της στη βελτίωση της απόδοσης αποκωδικοποίησης σε κάθε επίπεδο μοντέλου και token.

Επίδραση στις πολυσύστηματικές λύσεις

Ο Μπάκ ανέφερε ότι η Groq 3 LPX θα είναι κρίσιμος παράγοντας για το μελλοντικό AI‑πλαίσιο – τις πολυσυστημικές λύσεις. Όταν οι πράκτορες ανταλλάσσουν δεδομένα άμεσα, και όχι μέσω chatbot, οι απαιτήσεις απόκρισης αλλάζουν: από 100 tokens/s έως πάνω από 1 500+ tokens/s.

Ανταγωνιστές και προοπτικές

Στον κείμενο αναφέρεται ένας ανταγωνιστής – η Cerebras, που χρησιμοποιεί το Wafer‑Scale Engine (WSE) με τεράστια SRAM για χαμηλότερη καθυστέρηση inference. Η OpenAI έχει ήδη ενσωματώσει την Cerebras στα κορυφαία μοντέλα της λόγω της βολικής καθυστέρησης.

Ο Μπάκ ανέφερε επίσης ότι η εμφάνιση του Groq 3 LPU μπορεί να μειώσει την εξάρτηση από τον επιταχυντή Rubin CPX. Ενώ η Nvidia εστιάζει στην ενσωμάτωση της στήλης Groq 3 LPX με τη πλατφόρμα, και τα δύο chips προορίζονται για ενίσχυση του inference χωρίς την ανάγκη μεγάλων όγκων μνήμης GDDR7.

Συμπέρασμα:

Ο νέος χип Groq 3 LPU και η στήλη LPX ενισχύουν τη Vera Rubin στον τομέα χαμηλής καθυστέρησης inference, ανοίγοντας τον δρόμο για ταχύτερες πολυσυστημικές AI‑λύσεις και ανταγωνισμό με παίκτες όπως η Cerebras.

Asted Cloud

Asted Cloud

Σχόλια (0)

Μοιραστείτε τη γνώμη σας — παρακαλώ να είστε ευγενικοί και εντός θέματος.

Συνδεθείτε για να σχολιάσετε